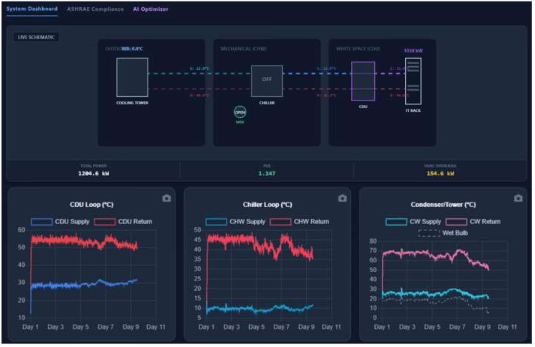

Rechenzentren verbrauchen jährlich enorme Mengen an Strom, wobei Kühlsysteme einen großen Teil des Energieverbrauchs ausmachen. Forscher der Pennsylvania State University haben eine auf künstlicher Intelligenz basierende Software entwickelt, die darauf abzielt, die Kühlung von Rechenzentren durch dynamische Anpassung des Stromverbrauchs zu optimieren, um auf Wetter- und Strompreisschwankungen zu reagieren.

Die Software nutzt ein physikinformiertes Reinforcement-Learning-Modell, analysiert Echtzeit-Klima- und Wirtschaftsdaten und simuliert ein virtuelles Rechenzentrum als Trainingsumgebung. Das trainierte KI-Agentensystem kann standortspezifische Kühlempfehlungen liefern, um Energieeffizienz und Rentabilität zu optimieren.

Professor Dazhuo Wang, korrespondierender Autor der Studie, erklärt: „Die Kühlung macht etwa 40 % des gesamten Stromverbrauchs eines Rechenzentrums aus, und traditionelle statische Kühlmethoden können bei hohen Strompreisen zu Verlusten führen. Unsere Software berücksichtigt externe Bedingungen und passt die Kühlrate dynamisch an.“ In Tests mit einer Simulation eines Rechenzentrums in Houston reduzierte das Team den Kühlenergieverbrauch um über 24 % und steigerte gleichzeitig die Rentabilität des Bitcoin-Minings um mehr als 8 %.

Dieser Ansatz ist nicht nur für Rechenzentren geeignet, sondern kann auch auf andere gewerbliche Gebäude wie Flughäfen und Kraftwerke ausgeweitet werden. Die Forscher planen, die Details ihrer Arbeit im Mai auf der IEEE ITherm-Konferenz in Orlando, Florida, vorzustellen.