Forscher des Korea Advanced Institute of Science and Technology (KAIST) und internationaler Forschungseinrichtungen haben eine neue Sicherheitslücke für künstliche Intelligenz (KI) entdeckt. Mithilfe einer kleinen Antenne können Angreifer die interne Struktur einer KI aus der Ferne ausspähen – selbst durch Wände hindurch. Diese Erkenntnis liefert wichtige Anhaltspunkte für den Schutz von KI-Systemen in Bereichen wie autonomes Fahren, Medizin und Finanzwesen.

Ein Forschungsteam unter der Leitung von Professor Jun Han von der KAIST School of Computing hat in Zusammenarbeit mit der National University of Singapore und der Zhejiang University das Angriffssystem „ModelSpy“ entwickelt. Dieses System nutzt eine Antenne, um die von einer GPU während des KI-Betriebs erzeugten elektromagnetischen Signale aufzufangen und analysiert diese, um die Modellstruktur zu rekonstruieren. Das zugehörige Forschungspapier wurde am 23. bis 27. Februar 2026 auf dem Network and Distributed System Security Symposium (NDSS 2026) in San Diego, USA, vorgestellt und mit einem Distinguished Paper Award ausgezeichnet.

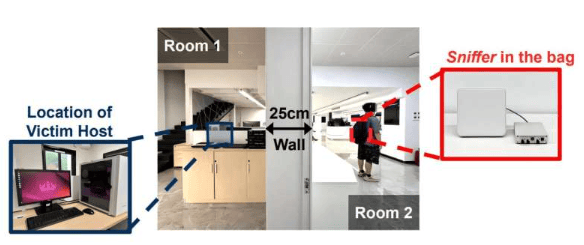

Experimente zeigten, dass auf fünf neuen GPU-Modellen die Struktur des KI-Modells mit hoher Genauigkeit aus einer Entfernung von 6 Metern oder durch Wände hindurch identifiziert werden konnte. Die Genauigkeit bei der Wiederherstellung der Schichtkonfiguration lag bei 97,6 %. Im Gegensatz zu herkömmlichen Hacking-Methoden erfordert dieser Angriff keinen Einbruch in Server oder die Installation von Malware. Er kann allein mit einer tragbaren Antenne durchgeführt werden, was die Heimtücke dieser KI-Sicherheitsbedrohung unterstreicht.

Als Gegenmaßnahme zu diesem Risiko schlug das Forschungsteam Abwehrstrategien wie elektromagnetische Störung und rechnerische Verschleierung vor, um geschäftskritische KI-Assets zu schützen. Professor Han erklärte: „Diese Studie zeigt, dass KI-Systeme selbst in physischen Umgebungen neuen Angriffsformen ausgesetzt sein können. Um kritische Infrastrukturen wie das autonome Fahren zu schützen, ist es von entscheidender Bedeutung, ein ‚cyber-physisches Sicherheitssystem‘ zu etablieren, das sowohl Hardware als auch Software umfasst.“