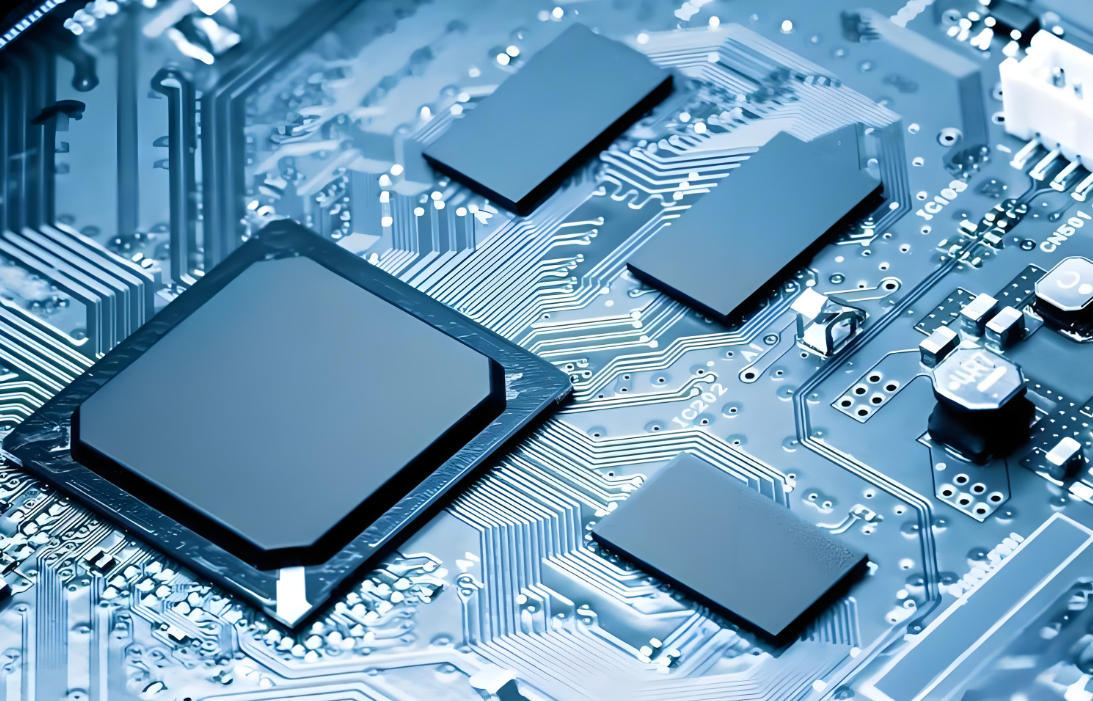

de.wedoany.com-Bericht: IBM Research hat gemeinsam mit NVIDIA und Samsung am 14. April 2026 einen Prototyp eines inhaltserkennenden Speichersystems vorgestellt. Dieses System unterstützt erfolgreich die Speicherung und Abfrage von Billionen von Vektoren auf einem einzelnen Server, mit einer durchschnittlichen Abfragelatenz von 694 Millisekunden und einer Trefferquote von 90 %. Die Hardware-Konfiguration umfasst eine IBM Storage Scale ESS 6000 All-Flash-Anlage, sechs NVIDIA H200 GPUs und 48 Samsung PCIe Gen5 NVMe Solid-State-Drives mit einer Kapazität von 30,72 TB.

Das Ziel dieser Lösung ist es, die Infrastrukturkomplexität und -kosten für Unternehmen bei der Bereitstellung von Retrieval-Augmented Generation (RAG)-Anwendungen zu senken. Die IBM CAS-Architektur verlagert Aufgaben wie die Vektorisierung von Dokumenten und den Indexaufbau, die ursprünglich von einer separaten Compute-Schicht verarbeitet wurden, direkt in das Speichersystem. Vincent Hsu, Chief Technology Officer für Storage bei IBM, weist darauf hin, dass Unternehmen angesichts des exponentiellen Wachstums von KI-Bereitstellungen dringend Datenbanken dieser Größenordnung benötigen, um ihre proprietären Daten für eine effektive KI-Nutzung zu organisieren. Aktuelle Vektordatenbank-Lösungen auf dem Markt erfordern oft die horizontale Skalierung über Dutzende oder sogar Hunderte von Servern, um Milliarden von Vektoren zu unterstützen.

Bei der Hardware-Konfiguration stellt Samsung 48 unternehmensfähige NVMe Solid-State-Drives bereit, die auf seiner neuesten Generation von TLC V-NAND Flash-Speicher basieren. Jedes Laufwerk bietet eine Speicherkapazität von 30,72 TB, mit einer maximalen sequentiellen Lesegeschwindigkeit von 12.000 MB/s und einer maximalen sequentiellen Schreibgeschwindigkeit von 6.800 MB/s. Die IBM Storage Scale ESS 6000 All-Flash-Anlage entkoppelt Rechenleistung und Speicher und beschleunigt den Index-Rebuild durch NVIDIA H200 GPUs. Dadurch wird der Indexaufbauprozess, der auf CPUs ursprünglich Stunden dauerte, auf GPUs auf wenige Minuten reduziert.

In der praktischen Leistungsvalidierung dauerte das Laden und Indizieren insgesamt 13 Tage, wobei der gesamte gespeicherte Datenplatz 153 TiB betrug. Zum Vergleich: Die gleiche Aufgabe auf einem Dual-Socket-Intel-CPU-System würde voraussichtlich 120 Tage benötigen. Das nächste Ziel von IBM und NVIDIA ist es, die Indizierung von über einer Billion Vektoren innerhalb eines Tages abzuschließen, die Datenerfassungszeit weiter zu verkürzen und die Abfragelatenz kontinuierlich mit der NVIDIA cuVS-Bibliothek zu optimieren.

Dieser Prototyp zeigt einen neuen Ansatz für die Dateninfrastruktur unternehmenskritischer KI-Anwendungen auf: Durch die Verlagerung von KI-Verarbeitungsfähigkeiten in die Speicherschicht besteht die Möglichkeit, die Kosten und die Managementkomplexität zu senken und gleichzeitig die Effizienz bei der Nutzung massiver unstrukturierter Daten zu steigern.

Dieser Artikel wurde von Wedoany übersetzt und bearbeitet. Bei jeglicher Zitierung oder Nutzung durch künstliche Intelligenz (KI) ist die Quellenangabe „Wedoany“ zwingend vorgeschrieben. Sollten Urheberrechtsverletzungen oder andere Probleme vorliegen, bitten wir Sie, uns unverzüglich zu benachrichtigen. Wir werden den entsprechenden Inhalt umgehend anpassen oder löschen.

E-Mail: news@wedoany.com