de.wedoany.com-Bericht: Ingenieure der École polytechnique fédérale de Lausanne (EPFL) haben einen neuartigen Rahmen für Robotersteuerungssysteme entwickelt, der es ermöglicht, Fertigkeiten an Roboter mit unterschiedlichen mechanischen Konstruktionen weiterzugeben, sodass diese dieselbe Aufgabe sicher ausführen können, ohne dass für jeden Roboter der Code neu geschrieben werden muss. Dieses Ergebnis eröffnet einen neuen Weg zur Vereinfachung der Roboterprogrammierung.

Traditionell bedeutete die Aufrüstung einer Flotte von Industrierobotern in der Regel, dass der Austausch von Hardware und die Neuprogrammierung von Aufgaben gleichzeitig vorangetrieben werden müssen. Selbst wenn zwei Maschinen für ähnliche Arbeiten konzipiert sind, führen Unterschiede in der Gelenkanordnung oder den Bewegungsbeschränkungen dazu, dass ein für einen Roboter geschriebenes Programm nicht direkt für einen anderen verwendet werden kann. Laut den Ingenieuren der EPFL könnte die direkte Übertragung von Fertigkeiten zwischen Robotern diese Systeme nachhaltiger und kosteneffizienter machen. Das Forschungsteam stellte das Konzept der „Bewegungsintelligenz“ vor, bei dem eine von Menschen demonstrierte Aufgabe mathematisch in eine universelle Bewegungsstrategie umgewandelt wird, die dann an die physische Konstruktion des Roboters angepasst wird, sodass verschiedene Roboter diese Aufgabe ausführen können.

Dr. Aude Billard, Leiterin des Learning Algorithms and Systems Laboratory, erklärte: „Diese Arbeit löst eine seit langem bestehende Herausforderung in der Robotik: Wie man erlernte Fertigkeiten unter der Gewährleistung eines sicheren und vorhersagbaren Verhaltens auf Roboter mit unterschiedlichen mechanischen Strukturen überträgt. Dieser Ansatz kann die Zeit und das Fachwissen, die für den Einsatz von Robotern in realen Umgebungen erforderlich sind, erheblich reduzieren.“

Um diesen Rahmen für Robotersteuerungssysteme zu entwickeln, zeichneten Billard und ihre Kollegen zunächst die von Menschen demonstrierten Aufgaben mittels Bewegungserfassungstechnik auf und wandelten sie anschließend mathematisch in universelle Bewegungsstrategien um. Das Team kategorisierte außerdem systematisch die physikalischen Einschränkungen verschiedener Roboterdesigns, einschließlich des Bewegungsspielraums der Gelenke und der Positionen, die zur Aufrechterhaltung der Stabilität vermieden werden müssen. Der Rahmen nutzt diese Kategorisierung, um die universelle Bewegungsstrategie automatisch an die verschiedenen Roboter körper anzupassen und so die sichere Ausführung der Aufgabe innerhalb der mechanischen Grenzen zu gewährleisten.

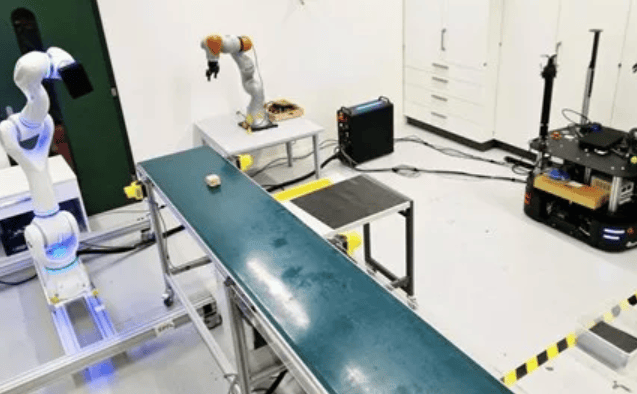

In einem Experiment an einer Montagelinie demonstrierte ein Mensch die Aufgabe, Holzklötze von einem Förderband auf einen Arbeitstisch zu schieben, auf einen Tisch zu legen und schließlich in einen Korb zu werfen. Drei verschiedene handelsübliche Roboter konnten diese Abfolge mithilfe der Bewegungsintelligenz erfolgreich und zuverlässig reproduzieren. Selbst wenn sich die Schrittzuweisung änderte, lief dieses Robotersteuerungssystem reibungslos weiter. Billard merkte an, dass das Team plant, den Rahmen auf Szenarien wie Mensch-Roboter-Kollaboration und sprachbasierte Interaktion auszuweiten, damit Menschen zu Hause mit einfachen Befehlen Roboter steuern können, ohne einen technischen Programmierhintergrund zu benötigen. Dieser Ansatz sei auch für aufstrebende Roboterplattformen mit schnellen Hardwareiterationen wertvoll, da die nahtlose Übertragung von Fertigkeiten über verschiedene Plattformen hinweg diesen Plattformen helfen könne, praktikable und skalierbare Anwendungen zu realisieren.

Dieser Artikel wurde von Wedoany übersetzt und bearbeitet. Bei jeglicher Zitierung oder Nutzung durch künstliche Intelligenz (KI) ist die Quellenangabe „Wedoany“ zwingend vorgeschrieben. Sollten Urheberrechtsverletzungen oder andere Probleme vorliegen, bitten wir Sie, uns unverzüglich zu benachrichtigen. Wir werden den entsprechenden Inhalt umgehend anpassen oder löschen.

E-Mail: news@wedoany.com